IA et RGPD : pourquoi l’hébergement en France n’est plus optionnel

La plupart des PME françaises qui ont intégré un assistant IA dans leurs processus utilisent ChatGPT, Gemini ou Copilot. Pratique, rapide, peu cher. Le problème, c’est qu’elles ont probablement transféré des données personnelles de leurs clients vers des serveurs américains sans base légale valable. Et sans le savoir.

Ce n’est pas un détail technique. C’est un risque juridique concret, et la CNIL a les moyens de le constater.

Le Cloud Act : la loi américaine qui vous concerne

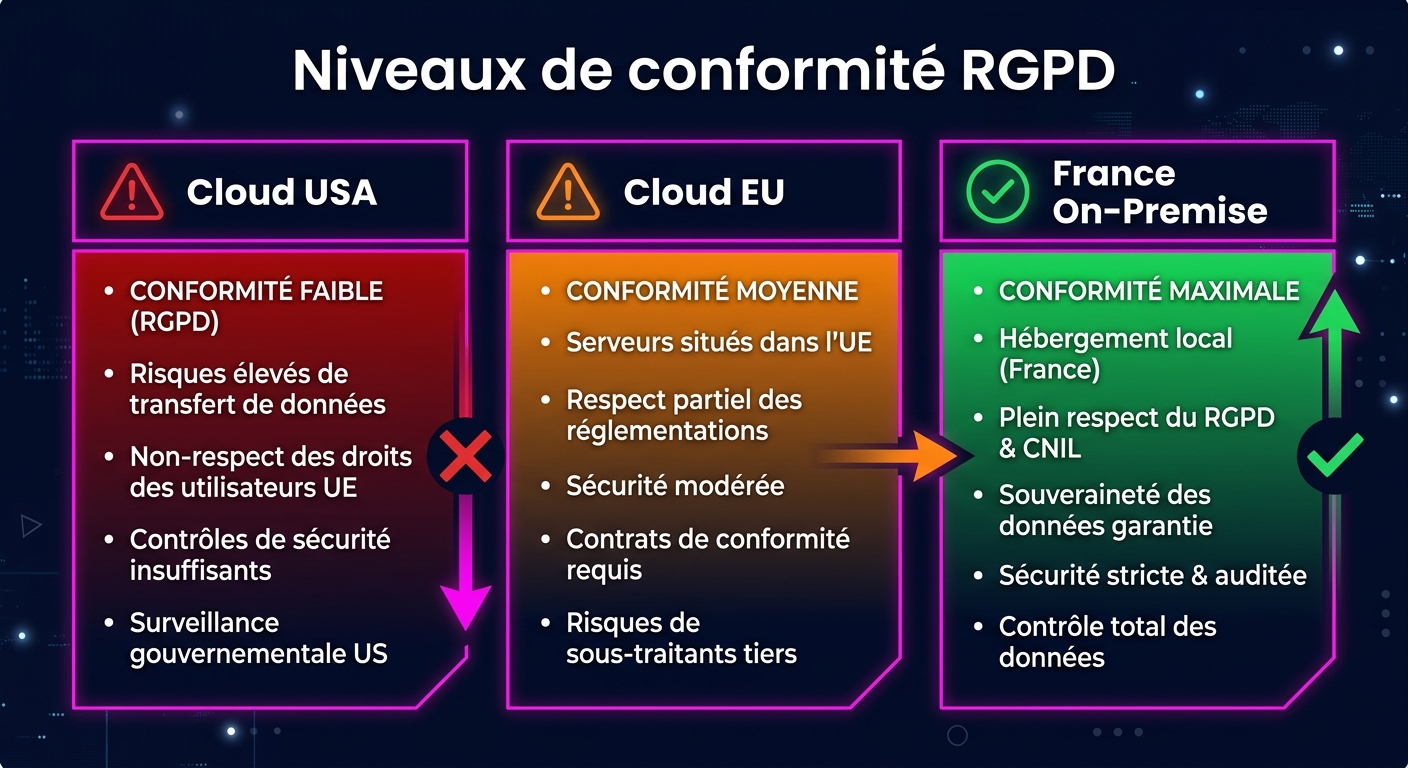

Le Cloud Act a été adopté aux États-Unis en 2018. Son principe est simple : le FBI ou la NSA peuvent contraindre n’importe quelle entreprise américaine à livrer des données stockées sur ses serveurs, peu importe où ces serveurs se trouvent géographiquement. Microsoft Azure en Irlande, AWS en Allemagne, Google Cloud en Belgique : tous sont soumis au Cloud Act si l’entreprise est américaine.

Le conflit avec le RGPD est direct. Tout transfert de données personnelles hors de l’Union européenne doit respecter des garanties précises : clauses contractuelles types, décision d’adéquation, ou mécanismes équivalents. Une injonction américaine reçue par un hébergeur américain ne rentre dans aucune de ces catégories. Le Comité européen de la protection des données (EDPB) l’a confirmé dans ses recommandations 01/2020 : la seule mesure technique vraiment efficace dans ce cas est un chiffrement contrôlé côté client, avec des clés hors de l’infrastructure du fournisseur.

En pratique, presque aucune entreprise ne met en place ce niveau de chiffrement quand elle utilise une API SaaS.

Ce que la CNIL dit exactement

La CNIL a publié ses premières recommandations sur l’IA en 2024, sous la forme de 12 fiches pratiques. Quelques points clés :

- Un assistant IA qui traite des données personnelles relève du RGPD, même si c’est un outil tiers utilisé en mode API.

- Une finalité claire doit être définie avant de traiter ces données. “Améliorer notre service client” ne suffit pas.

- La base légale la plus adaptée pour déployer un agent conversationnel est l’intérêt légitime, selon la CNIL. Mais cet intérêt doit être documenté.

- Les personnes concernées ont le droit d’être informées que leurs données alimentent un système d’IA.

Sur le terrain des sanctions, les chiffres donnent une idée du niveau d’exigence. En 2024, la CNIL a prononcé 87 sanctions pour un total de plus de 55 millions d’euros. En 2025, la barre est montée à 487 millions d’euros, portée par deux sanctions majeures contre Google et Shein. La tendance est claire : la CNIL monte en puissance, et les manquements liés à l’IA sont désormais sur son radar.

L’AI Act ajoute une couche en 2025

Le règlement européen sur l’intelligence artificielle (règlement UE 2024/1689) est entré en vigueur le 1er août 2024. Il ne remplace pas le RGPD, il le complète. Les deux textes s’appliquent simultanément dès lors que votre système d’IA traite des données personnelles.

Depuis le 2 août 2025, les règles applicables aux modèles d’IA à usage général sont en vigueur. Si vous utilisez un LLM grand public pour traiter des données de vos clients, vous devez être capable de justifier votre choix, de documenter les risques, et de démontrer que le modèle ne génère pas d’impact discriminatoire ou illicite.

Autrement dit, “on utilise ChatGPT parce que c’est pratique” n’est plus une réponse acceptable dans un audit de conformité.

Les solutions françaises : état des lieux

La bonne nouvelle, c’est qu’il existe aujourd’hui des alternatives sérieuses à l’écosystème américain.

Mistral AI

Mistral AI est une entreprise de droit français, soumise au RGPD et à la supervision de la CNIL. Ses modèles open weights (Mistral Small, Mistral Large) peuvent être déployés en local, ce qui signifie qu’aucune donnée ne quitte votre infrastructure. Des groupes comme AXA, Capgemini et Bouygues utilisent Mistral précisément pour cette raison : maîtrise juridique et souveraineté technique.

Un point de vigilance toutefois : en mode API Mistral.ai (le service cloud grand public), une plainte a été déposée auprès de la CNIL pour non-conformité sur le traitement des données personnelles des utilisateurs. Pour une utilisation en entreprise avec des données sensibles, le déploiement on-premise ou via un hébergeur souverain est préférable au simple accès API.

OVHcloud

OVHcloud est certifié ISO 27001 et HDS (Hébergeur de Données de Santé). Il propose des services d’infrastructure pour héberger des LLM en France, hors de portée du Cloud Act. OVHcloud a récemment acquis Dragon LLM pour constituer un laboratoire d’IA souveraine, et est l’un des quatre fournisseurs retenus par la Commission européenne pour fournir des services cloud aux institutions de l’UE, dans le cadre d’une commande pouvant atteindre 180 millions d’euros sur six ans.

Scaleway

Scaleway, filiale du groupe Iliad, propose des hébergements LLM clé-en-main depuis ses datacenters en France. C’est le premier fournisseur européen à avoir proposé les GPU NVIDIA Blackwell Ultra. Pour les entreprises qui veulent inférer des modèles ouverts (Mistral, LLaMA) sur une infrastructure 100% européenne, c’est une option directement utilisable via API.

La certification SecNumCloud

Au-delà des fournisseurs, la certification SecNumCloud délivrée par l’ANSSI garantit que l’opérateur est localisé en Europe, non soumis à une législation extraterritoriale (dont le Cloud Act), et qu’il répond aux exigences françaises de résilience et de traçabilité. Pour les données les plus sensibles, c’est le niveau de garantie le plus élevé disponible en France.

Comment déployer un assistant IA conforme : les étapes

Le chemin le plus court vers la conformité dépend du niveau de sensibilité de vos données.

Si vos données sont peu sensibles (FAQ, gestion de planning, support niveau 1 sans données personnelles identifiantes), un LLM hébergé en UE avec un contrat de sous-traitance en bonne forme suffit dans la plupart des cas. Vérifiez que le contrat précise explicitement que les données ne sont pas réutilisées pour l’entraînement du modèle.

Si vous traitez des données personnelles classiques (noms, emails, historique d’achat, conversations clients), voici les étapes minimales :

- Choisir un hébergeur soumis au droit européen uniquement (pas de filiale américaine)

- Signer un contrat de sous-traitance conforme à l’article 28 du RGPD

- Documenter la finalité et la base légale dans votre registre de traitement

- Informer vos utilisateurs que leurs interactions avec l’IA sont traitées

Pour les données sensibles (données de santé, données RH, données financières), le déploiement on-premise d’un modèle open weights comme Mistral Small sur votre propre infrastructure est la solution la plus sûre. L’inférence se fait localement, aucune donnée ne sort.

Le vrai coût de l’inaction

Beaucoup de dirigeants voient la conformité RGPD comme un coût, pas comme une protection. C’est une erreur de calcul.

Une sanction CNIL peut aller jusqu’à 4% du chiffre d’affaires annuel mondial, ou 20 millions d’euros, selon le montant le plus élevé. Pour une PME avec 5M€ de CA, le plafond théorique est de 200.000€. En pratique, les amendes pour les PME sont généralement moindres, mais une mise en demeure publique et les dommages réputationnels associés peuvent coûter beaucoup plus.

De plus en plus d’appels d’offres publics et de contrats grands comptes intègrent des clauses de conformité RGPD avec justification de l’hébergement. Une entreprise qui ne peut pas répondre à ces clauses perd des marchés.

Ce que Noxcod fait pour ses clients

Quand nous développons un agent IA pour une entreprise, la question de l’hébergement est tranchée avant même que la première ligne de code soit écrite. Nos déploiements en France utilisent soit Scaleway, soit OVHcloud, soit une infrastructure on-premise selon le niveau de sensibilité des données. Nous configurons systématiquement les contrats de sous-traitance et documentons la finalité et la base légale dans le registre de traitement du client.

Ce n’est pas parce que c’est une obligation légale. C’est parce qu’un agent IA déployé sans cette rigueur finira par poser un problème, et le problème surviendra au pire moment.

Questions fréquentes

Peut-on utiliser ChatGPT en entreprise en respectant le RGPD ?

Oui, sous conditions. OpenAI propose une option “doannées non utilisées pour l’entraînement” via son API entreprise, et a signé des clauses contractuelles types conformes au RGPD. Cela ne résout pas entièrement le problème du Cloud Act, mais ça adresse une grande partie du risque pour des données non sensibles. Pour des données sensibles, la réponse est non : le risque résiduel reste trop élevé.

Mistral AI est-il vraiment souverain si on utilise leur API ?

Pas entièrement. En mode API Mistral.ai, les données transitent par leurs serveurs. Mistral AI est une société française, mais ça ne garantit pas que des partenaires d’infrastructure tiers ne sont pas impliqués. Pour une souveraineté complète, le déploiement on-premise des modèles open weights est la seule option qui garantit qu’aucune donnée ne sort de votre contrôle.

La conformité RGPD pour l’IA est-elle vérifiable par la CNIL ?

Oui. La CNIL peut demander votre registre de traitement, les contrats de sous-traitance, et des preuves que vous avez informé les personnes concernées. Elle peut aussi conduire des audits techniques. En 2024, 27 organismes ont été sanctionnés simplement pour ne pas avoir répondu aux sollicitations de la CNIL, sans même qu’un manquement sur le fond soit constaté.

Quel budget prévoir pour un déploiement IA conforme en France ?

Pour un déploiement cloud sur Scaleway ou OVHcloud avec un modèle manaég, comptez à partir de 300-500€ par mois pour un usage PME. L’écart de coût par rapport aux API américaines est réel, mais il inclut la conformité, la maîtrise des données, et l’absence de risque juridique résiduel.